LG AI연구원이 지난 10~11일(현지시간) 프랑스 파리에서 열린 '인공지능(AI) 행동 정상회의'에서 데이터의 신뢰성을 높이는 AI 기술을 제시했다고 12일 밝혔다.

LG AI연구원은 회의에 참가해 'AI 윤리 책무성 보고서'를 공유했다. 지난해에 이어 올해 두 번째로 발간한 보고서는 책임 있는 AI와 포용적 AI 실현을 위한 LG의 노력을 담고 있다.

특히 보고서에는 '모든 문제는 데이터 문제로부터 시작된다'는 인식하에 LG AI연구원이 개발한 '데이터 컴플라이언스 에이전트'도 담겼다. 이는 AI 모델이 학습하는 데이터의 위험을 자동으로 분석하고 위험 등급을 평가하는 체계다.

데이터 컴플라이언스 에이전트는 미국, 영국, 유럽연합(EU), 한국, 중국을 포함한 다양한 관할권의 저작권법과 판례, AI 규제 등을 고려해 데이터의 법적 위험성을 평가해준다. 실제로 LG AI연구원이 데이터 컴플라이언스 에이전트로 수백 건의 AI 학습 데이터의 법적 안정성을 검토한 결과, 법률 전문가보다 정확도는 26% 향상되고, 속도는 45배 높이고, 비용은 0.1% 수준으로 낮춘 것으로 확인됐다. LG AI연구원은 데이터 컴플라이언스 에이전트가 AI의 법적 안정성을 높이는 데 기여할 수 있음을 증명한 연구 성과를 공개하고 글로벌 표준 기술로 자리 잡을 수 있도록 글로벌 법률 전문가들과 협력을 강화한다는 계획이다.

[박승주 기자]

[ⓒ 매일경제 & mk.co.kr, 무단전재 및 재배포 금지]

LG AI연구원은 회의에 참가해 'AI 윤리 책무성 보고서'를 공유했다. 지난해에 이어 올해 두 번째로 발간한 보고서는 책임 있는 AI와 포용적 AI 실현을 위한 LG의 노력을 담고 있다.

특히 보고서에는 '모든 문제는 데이터 문제로부터 시작된다'는 인식하에 LG AI연구원이 개발한 '데이터 컴플라이언스 에이전트'도 담겼다. 이는 AI 모델이 학습하는 데이터의 위험을 자동으로 분석하고 위험 등급을 평가하는 체계다.

데이터 컴플라이언스 에이전트는 미국, 영국, 유럽연합(EU), 한국, 중국을 포함한 다양한 관할권의 저작권법과 판례, AI 규제 등을 고려해 데이터의 법적 위험성을 평가해준다. 실제로 LG AI연구원이 데이터 컴플라이언스 에이전트로 수백 건의 AI 학습 데이터의 법적 안정성을 검토한 결과, 법률 전문가보다 정확도는 26% 향상되고, 속도는 45배 높이고, 비용은 0.1% 수준으로 낮춘 것으로 확인됐다. LG AI연구원은 데이터 컴플라이언스 에이전트가 AI의 법적 안정성을 높이는 데 기여할 수 있음을 증명한 연구 성과를 공개하고 글로벌 표준 기술로 자리 잡을 수 있도록 글로벌 법률 전문가들과 협력을 강화한다는 계획이다.

[박승주 기자]

[ⓒ 매일경제 & mk.co.kr, 무단전재 및 재배포 금지]

화제의 뉴스

오늘의 이슈픽

인기 영상

가장 많이 본 뉴스

- 1경제 격변기 재테크 전략은?…'2025 서울머니쇼'...

- 2"재생의료 게임체인저"…오가노이드사이언스, 오늘 코...

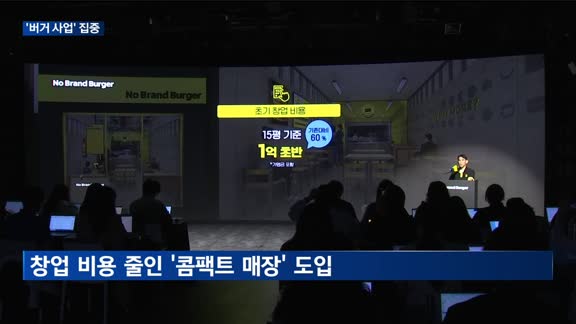

- 3외식 사업 재정비 나선 '신세계푸드'…'노브랜드 버...

- 4오가노이드사이언스, 코스닥 입성…상장 첫날 강세

- 5사모펀드 케이엘앤파트너스, 1천900억원에 마녀공장...

- 6매일경제TV증시 오늘 ‘핫이슈’ “4년 괴로움의 끝...

- 7트럼프, 미·영 무역합의 발표 임박…"첫 번째 국가...

- 8[매일경제TV 야간투자본부] "수익률의 승부사"…M...

- 9최민희 "3월중 SKT 내부 인증서버서 비정상 트래...

- 10SKT 해킹 여파…26만명 타사로 이동

투데이 포커스

화제의 뉴스

포토뉴스

![[집중취재] 어두운 국내 경제 전망…발등에 불 떨어진 '경기 부양'](https://imgmm.mbn.co.kr/vod/news/103/2025/05/09/20250509164840_10_103_0_MM1005549295_4_259.jpg)

![[밸류업5000] 밸류업 시행 1년…자사주 취득액 연간 20조원 '첫 돌파'](https://imgmm.mbn.co.kr/vod/news/103/2025/05/09/20250509164840_10_103_0_MM1005549153_4_98.jpg)

![[밸류업 5000] 삼성전자, 밸류업 지수서 빠지나…공시 자료 미제출](https://imgmm.mbn.co.kr/vod/news/103/2025/05/09/20250509162952_10_103_0_MM1005549161_4_20.jpg)

![[밸류업 5000] 코웨이, 1천100억 자사주 매입 결정](https://imgmm.mbn.co.kr/vod/news/103/2025/05/09/20250509162952_10_103_0_MM1005549160_4_21.jpg)